Maximum Likelihood Estimation

Likelihood function이란 무엇인가?

파라미터 해석에 따라 얼마나 관측치가 얼마나 가능성이 있는지를 표현하는 것을 의미합니다.

즉, 저희가 집중해야 하는 것은 파라미터를 어떻게 해석하느냐인데 파라미터로부터 도출되는 값(얼마나 가능성이 있는지에 대한 값 == Likelihood)이 가장 큰 것을 찾기 위한 방법이 MLE 방법입니다.

보통 MLE를 구할 때 Log 를 붙이게 되는데 그 이유는 Log함수는 단일 증가함수 이기 때문에 기존 최대값을

갖게되는 세타에 영향을 미치지 않고 계산을 더 쉽게할 수 있기 때문입니다. 또한 Log 연산의 경우 곱셈이 모두 합으로 표현되는 장점이 있습니다.

Binomial Distribution의 경우를 살펴보면 unknown 파라미터로부터 동전을 던졌을 때 head가 x번 나올 수 있는 확률을 추정하는 것입니다. Log를 취하면서 덧셈으로 나뉘어지고, 파라미터가 없는 항은 상수처리되어

계산되는 과정을 보면 이해가 될 것입니다.

다음은 가우시안 분포를 가정하는 경우 파라미터 세타의 추정하는 과정을 살펴보겠습니다.

해당 파라미터가 가우시안 분포를 따른다고 가정합니다. 첫 번째 추정의 경우는 데이터 셋 하나로부터 평균과 분산을 계산한 경우이고 두 번째 추정의 경우는 전체 데이터 셋으로부터 평균과 분산을 계산한 것입니다. 이로써 Estimator는 unbiased 하다고 표현할 수 있는데, 그 이유는 두 개의 추정 모두 평균이 동일하기 때문입니다.

위의 두 추정을 통하여 우리는 경험적으로 평균은 파라미터의 MLE 값을 가진다는 것을 알 수 있습니다.

하지만 이를 MLE 를 통하여 증명을 해야 합니다. θ1과 θ2가 각각 평균과 분산에 가까이 추정됨을 보여야 합니다. 이 경우 정규분포를 가정하고 있으므로 Parameteized Density는 흔히 알고 있는 정규분포 함수로

작성될 수 있습니다. 여기에 Log-likihood를 취하게 되는 경우 아래처럼 표현됩니다.

Log likelihood 함수에서 이제 최댓값이 0이 되는 Stationary point를 찾아야 합니다.

Stationary Point란 Gradient가 0이 되는 지점을 의미하고 θ1과 θ2에 대해 각각을 Log likelihood

함수를 미분하면 경험적으로 생각한 데이터에 근접함을 알 수 있다.

Kullback-Leibler (KL) divergence

보통 Model를 Fitting 한다고 했을 때 이것은 경험적 분포와 확률적 모델의 거리 차이를 줄이는 것으로

해석될 수 있다. 그렇다면 이렇게 추정한 p.d.f 간의 유사도를 확인하는 방법이 존재하는가?

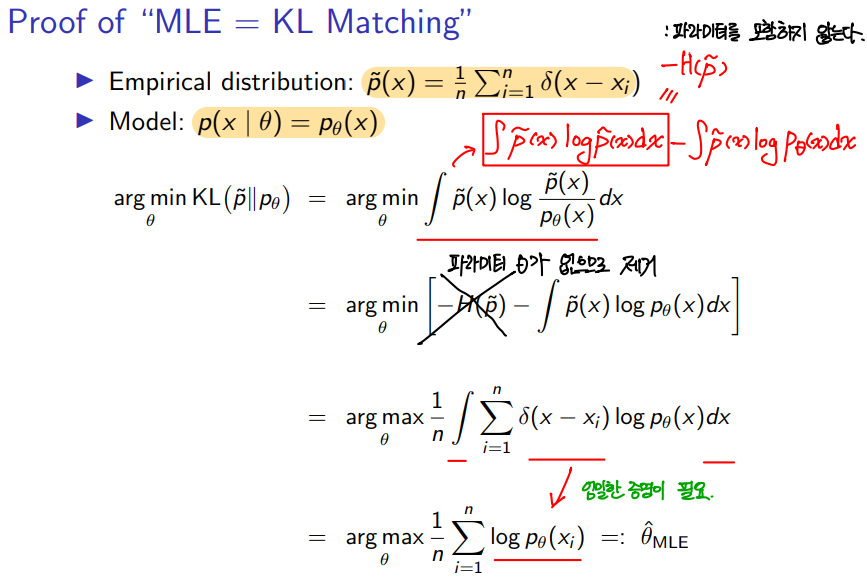

Kullback-Leibler divergence 방법이 존재한다. KL Matching의 경우 두 거리가 최소가 되는 지점이 MLE에서 최대가 되는 지점일텐데 이 두 가지가 동일하다고 볼 수 있는지 증명을 해야 한다. 아래에서 보이는 증명 중 엔트로피가 사라지는 부분이 존재하는데 이는 파라미터가 존재하지 않는 항이므로 상수처리가 된다.

'🌴 Course Review (Master) > 🚀 기계 학습' 카테고리의 다른 글

| 기계학습에서 Estimation을 하는 근본적 이유. Parametric Estimation이란? (0) | 2024.03.07 |

|---|